93 Prozent klicken blind auf „Genehmigen“ – ist das noch Sicherheit?

Wer mit KI-Coding-Tools arbeitet, kennt das Muster: Jede Dateiänderung, jeder Bash-Befehl fordert eine Bestätigung. Am Anfang liest man noch mit. Nach dem zehnten Klick genehmigt man reflexhaft. Nach dem dreißigsten hat man längst aufgehört hinzuschauen.

Laut Anthropic bestätigen 93 Prozent der Nutzer die Berechtigungsabfragen, ohne sie zu lesen. Die Sicherheitsabfrage wird zur Farce – ein Gummistempel, der Kontrolle suggeriert, wo längst keine mehr stattfindet.

Genau dieses Problem adressiert Anthropic jetzt mit dem neuen Auto Mode für Claude Code. Seit dem 24. März 2026 verfügbar, zunächst als Research Preview für Team-Pläne. Doch die eigentliche Nachricht liegt tiefer: Sie zeigt exemplarisch, wie KI-Autonomie und Sicherheit in der Praxis zusammenspielen müssen.

Was steckt hinter dem Auto Mode?

Claude Code ist Anthropics KI-Coding-Agent, der direkt im Terminal oder in der IDE arbeitet. Er kann Code schreiben, Dateien ändern, Tests ausführen und ganze Refactorings über mehrere Dateien hinweg durchführen.

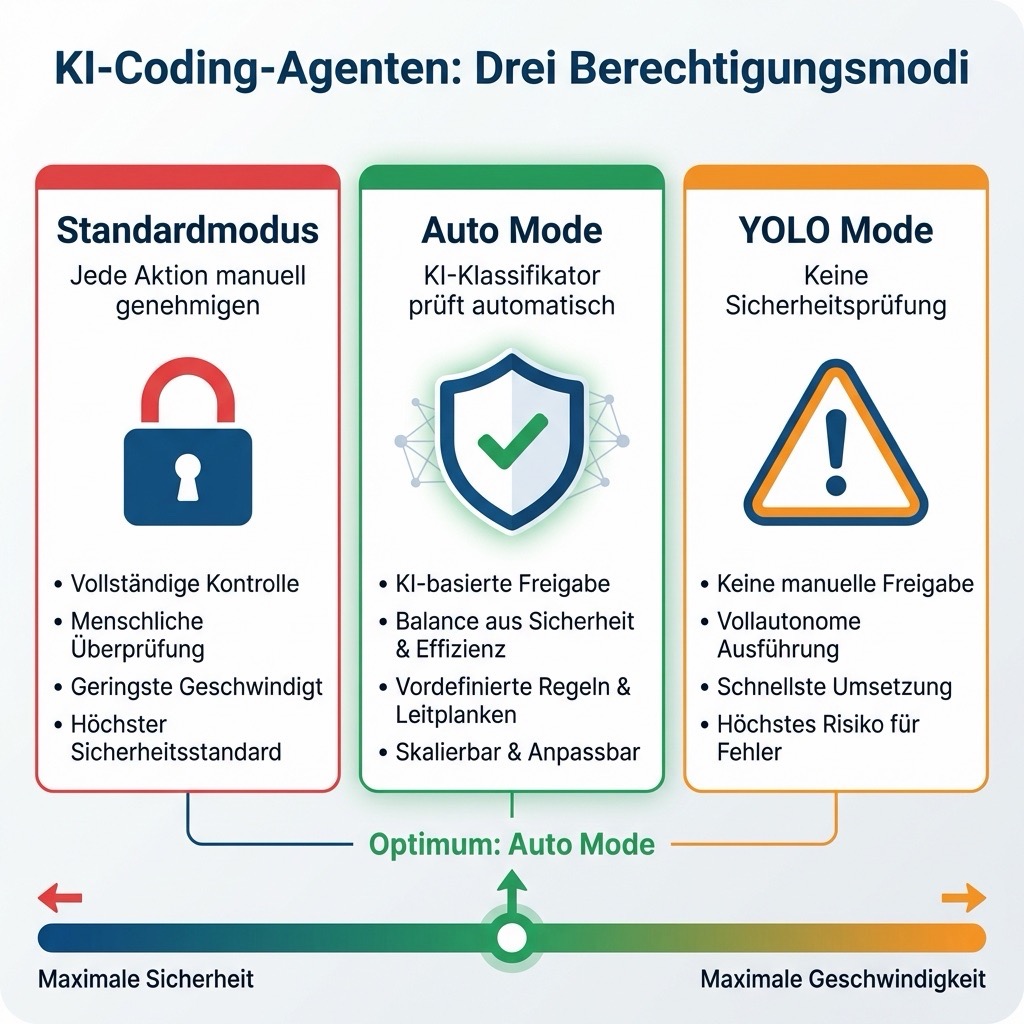

Bisher gab es zwei Extreme:

- Standardmodus: Jede Aktion erfordert eine manuelle Genehmigung. Sicher, aber bei größeren Aufgaben kaum praktikabel.

- --dangerously-skip-permissions: Alle Sicherheitsabfragen werden übersprungen. Schnell, aber potenziell gefährlich. Entwickler nennen es „YOLO Mode“.

Der Auto Mode ist der Mittelweg. Vor jeder Aktion prüft ein separater KI-Klassifikator, ob die geplante Aktion sicher ist. Ungefährliche Aktionen laufen automatisch durch. Riskante Aktionen – etwa das massenhafte Löschen von Dateien, die Exfiltration sensibler Daten oder die Ausführung von schadhaftem Code – werden blockiert.

Wichtig: Der Klassifikator sieht nur die Benutzeranweisung und den konkreten Tool-Aufruf. Er sieht nicht die Begründung des Agenten, warum eine Aktion sicher sei. Damit kann sich der Agent nicht „rausreden“ – ein bewusstes Designprinzip.

Warum das jetzt relevant ist: KI-Agenten werden autonom – und riskanter

Der Auto Mode ist kein isoliertes Feature. Er steht symptomatisch für eine Entwicklung, die 2026 alle Bereiche der IT betrifft: KI-Systeme handeln zunehmend eigenständig – und die bisherigen Kontrollmechanismen halten nicht Schritt.

Die Zahlen sprechen eine deutliche Sprache: Laut Gartner werden bis 2028 bereits 40 Prozent aller neuen Unternehmenssoftware mit KI-gestützten Techniken wie „Vibe Coding“ erstellt. 84 Prozent der Entwickler nutzen bereits KI-Tools. Und 48 Prozent der Cybersecurity-Experten stufen agentische KI als den gefährlichsten Angriffsvektor für 2026 ein – noch vor Deepfakes.

Das Problem ist nicht die KI selbst, sondern die fehlende Infrastruktur drumherum. Anthropics internes Incident-Log dokumentiert Fälle, in denen Agenten im YOLO-Modus Remote-Git-Branches gelöscht, GitHub-Tokens auf Compute-Cluster hochgeladen und Migrationen gegen Produktionsdatenbanken ausgeführt haben.

„Wer KI-Agenten ohne klare Berechtigungskonzepte und Monitoring laufen lässt, wiederholt den Fehler der frühen Cloud-Ära: Geschwindigkeit vor Governance. Anthropics Auto Mode zeigt den richtigen Ansatz – Autonomie mit eingebauten Leitplanken. Genau das müssen wir auch unseren Kunden vermitteln.“ – Ingo Lücker, Gründer der KI LEAGUE

Das Architekturprinzip: Autonomie braucht eine zweite Instanz

Was Anthropic mit dem Auto Mode technisch umsetzt, ist ein Architekturmuster, das über Coding hinaus Relevanz hat: Ein handelnder Agent wird durch ein unabhängiges Kontrollsystem überwacht.

Der Klassifikator läuft auf einem separaten Modell (Sonnet 4.6). Er kennt den Kontext der Aufgabe und bewertet jede einzelne Aktion, bevor sie ausgeführt wird. Wird eine Aktion drei Mal hintereinander blockiert oder 20 Mal in einer Sitzung, schaltet das System zurück in den manuellen Modus.

Das Prinzip dahinter ist auf jedes agentische KI-System übertragbar:

- Trenne den Ausführenden vom Kontrolleur

- Lass den Agenten sich nicht selbst freigeben

- Definiere klare Eskalationsstufen

- Baue Fallback-Mechanismen ein, die bei Unsicherheit auf menschliche Kontrolle zurückschalten

Wie Heise in einer Analyse zu Agentic Coding treffend zusammenfasst: Fehlentscheidungen von KI-Agenten schleichen sich nicht ein – sie skalieren sofort. Ein Agent kann eine Methode korrekt implementieren, aber nicht erkennen, dass sie in einem sicherheitskritischen Pfad liegt.

Was das für IT-Dienstleister bedeutet

Du musst kein Softwareentwickler sein, um aus dem Auto Mode die richtigen Schlüsse zu ziehen. Die Prinzipien gelten überall dort, wo KI-Agenten in Kundenumgebungen eingesetzt werden:

Kunden werden fragen:

- Wie kontrollieren wir, was KI-Agenten in unserer Umgebung tun?

- Wer haftet, wenn ein Agent Daten löscht oder sensible Informationen nach außen trägt?

- Wie dokumentieren wir KI-gesteuerte Aktionen für Audits und Compliance?

- Wie setzen wir ein Berechtigungskonzept für KI-Agenten um?

Laut einer Forrester-Studie für Reply sind 81 Prozent der Führungskräfte überzeugt, dass agentische KI innerhalb der nächsten drei bis fünf Jahre für die Wettbewerbsfähigkeit unverzichtbar wird. Gleichzeitig erreichen nur 20 Prozent der Unternehmen eine durchgängige KI-Integration. Hier liegt das Geschäftsfeld für IT-Dienstleister: nicht die KI selbst liefern, sondern die Governance, das Monitoring und die Architektur drumherum.

Gartner-Analyst Alex Michaels warnt in seinem Cybersecurity-Trendreport 2026, dass der Aufstieg von No-Code-Plattformen und Vibe Coding zu einer Proliferation unverwalteter KI-Agenten führe, die in Unternehmensnetzwerken operieren, ohne dass die Sicherheitsteams davon wissen.

Die richtige Einordnung: Leitplanken vor Geschwindigkeit

Was jetzt sinnvoll ist:

- Berechtigungskonzepte für KI-Agenten entwickeln – analog zu IAM für Cloud-Dienste

- Monitoring und Audit-Logs für agentische Systeme einplanen

- Das Prinzip „Agent + Kontrollinstanz“ als Architekturstandard etablieren

- Kunden proaktiv über die EU-KI-Verordnung und deren Pflichten bei agentischen Systemen informieren

Was nicht sinnvoll ist:

- KI-Agenten ohne Governance in Kundenumgebungen ausrollen

- Auf „YOLO Mode“ setzen und hoffen, dass nichts passiert

- Das Thema KI-Sicherheit auf später verschieben – denn die Agenten sind schon da

Einladung zum nächsten KI LEAGUE Live Talk

Der Live Talk richtet sich bewusst an IT-Dienstleister und Systemhäuser, die KI einordnen wollen. Die Teilnahme ist kostenlos – der Austausch ausdrücklich erwünscht.

Die KI LEAGUE ist der Ort für IT-Dienstleister, die KI nicht hypen, sondern verstehen wollen. Als Plattform für Einordnung, Austausch und kritische Diskussion – jenseits von Buzzwords und Produktversprechen.