Ein CMS-Fehler legt offen, was niemand sehen sollte

Am 26. März 2026 wurde bekannt, was Anthropic lieber noch unter Verschluss gehalten hätte: Das Unternehmen hat ein neues KI-Modell fertig trainiert, das intern den Codenamen "Claude Mythos" trägt. Aufgedeckt hat das nicht etwa ein Whistleblower, sondern ein simpler Konfigurationsfehler im Content-Management-System. Rund 3.000 Assets, darunter ein unveröffentlichter Blogartikel-Entwurf, waren öffentlich durchsuchbar und abrufbar.

Das Magazin Fortune fand die Materialien zuerst. Zwei Cybersecurity-Forscher – Roy Paz von LayerX Security und Alexandre Pauwels von der University of Cambridge – bestätigten den Fund unabhängig voneinander. Anthropic räumte den Vorfall ein und sprach von einem "menschlichen Fehler" bei der CMS-Konfiguration.

Die Ironie ist schwer zu übersehen: Ein Unternehmen, das mit "beispiellosen Cybersecurity-Risiken" seines eigenen Modells warnt, verliert die Kontrolle über sensible Informationen durch eine banale Fehlkonfiguration. Genau die Art von Schwachstelle, die KI-Modelle der nächsten Generation in Sekundenbruchteilen finden könnten.

Was steckt hinter Claude Mythos und Capybara?

Der geleakte Blogartikel-Entwurf beschreibt Claude Mythos als "bei Weitem das leistungsfähigste KI-Modell, das wir je entwickelt haben". Das Modell wird aktuell mit einer kleinen Gruppe von Early-Access-Kunden getestet. Ein Anthropic-Sprecher bestätigte gegenüber Fortune, dass es sich um einen "Quantensprung" in der KI-Leistung handele.

Gleichzeitig führt Anthropic eine neue Modell-Stufe ein: "Capybara". Diese siedelt sich oberhalb der bisherigen Opus-Klasse an – also größer, intelligenter und teurer. Capybara und Mythos scheinen auf dasselbe zugrundeliegende Modell zu verweisen. Bisher kannte Anthropics Produktlinie drei Stufen: Haiku (schnell und günstig), Sonnet (ausgewogen) und Opus (leistungsstark). Capybara wäre die vierte, oberste Stufe.

Der Entwurf nennt konkret: Im Vergleich zum bisherigen Spitzenmodell Claude Opus 4.6 erziele Capybara "dramatisch höhere Werte" in Software-Coding, akademischem Reasoning und Cybersecurity. Letzteres ist der Punkt, der die Branche aufhorchen lässt.

Warum Anthropic selbst vor seinem Modell warnt

Der geleakte Entwurf enthält eine bemerkenswert deutliche Warnung: Das Modell sei "derzeit jedem anderen KI-Modell in Cyber-Fähigkeiten weit voraus" und es kündige "eine kommende Welle von Modellen an, die Schwachstellen auf eine Weise ausnutzen können, die den Bemühungen der Verteidiger weit voraus ist".

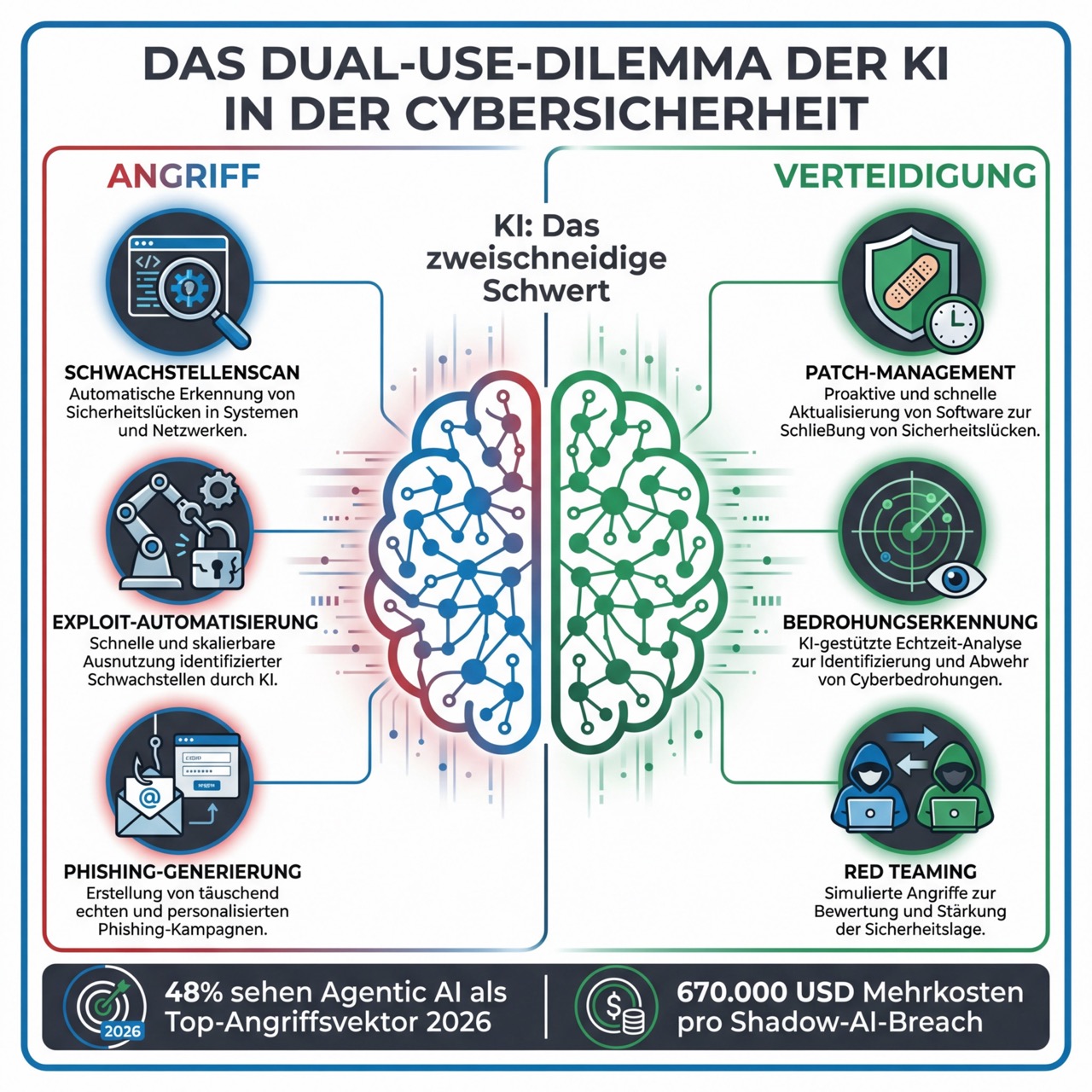

Das bedeutet in der Praxis: Claude Mythos kann Software-Schwachstellen nicht nur identifizieren, sondern potenziell auch automatisiert ausnutzen. Für Angreifer wäre das ein Werkzeug, mit dem sich Cyberattacken in einer Geschwindigkeit und Präzision durchführen ließen, die menschliche Red Teams kaum erreichen.

"Es kommt nicht mehr darauf an, ob man gehackt wird oder wann, sondern wie oft! Wenn ein KI-Modell Schwachstellen schneller findet als jedes Pentesting-Team, dann müssen wir als IT-Dienstleister unsere Kunden genau darauf vorbereiten – auf die Frequenz, nicht nur auf den Einzelfall." – Ingo Lücker, Gründer der KI LEAGUE

Laut Axios warnt Anthropic hinter verschlossenen Türen bereits ranghohe Regierungsvertreter, dass Mythos die Wahrscheinlichkeit großangelegter Cyberangriffe im Jahr 2026 deutlich erhöht. Die Rollout-Strategie ist entsprechend vorsichtig: Der Early Access geht gezielt an Organisationen mit Fokus auf Cyberabwehr, damit diese ihre Systeme härten können, bevor das Modell breiter verfügbar wird.

Kein Einzelfall: Die gesamte Branche steht vor derselben Schwelle

Anthropic ist nicht allein mit diesem Problem. Bereits im Februar 2026 hat OpenAI bei der Veröffentlichung von GPT-5.3-Codex gewarnt, dass es sich um das erste Modell handle, das unter dem eigenen Preparedness Framework als "high capability" im Bereich Cybersecurity eingestuft wurde. Anthropics Opus 4.6, in derselben Woche erschienen, zeigte ebenfalls die Fähigkeit, bisher unbekannte Schwachstellen in produktiven Codebasen zu finden – ein klassischer Dual-Use-Fall.

Parallel dazu wächst die Bedrohung durch das, was die Branche "Shadow AI" nennt: Mitarbeitende, die KI-Agenten ohne Wissen der Security-Abteilung einsetzen und dabei ungewollt Einfallstore für Angreifer öffnen. Eine Dark-Reading-Umfrage zeigt, dass 48 Prozent der Cybersecurity-Fachleute agentic AI als Angriffsvektor Nummer eins für 2026 einstufen – noch vor Deepfakes und allen anderen Bedrohungen.

Laut IBMs Cost of a Data Breach Report 2025 verursachen Sicherheitsvorfälle im Zusammenhang mit Shadow AI im Schnitt 670.000 US-Dollar Mehrkosten pro Breach. 63 Prozent der untersuchten Unternehmen hatten keine KI-Governance-Richtlinien. 97 Prozent der Unternehmen mit KI-bezogenen Sicherheitsvorfällen verfügten über keine angemessenen KI-Zugriffskontrollen.

Börsenreaktion: Cybersecurity-Aktien unter Druck

Die Reaktion der Märkte kam unmittelbar. Nach Bekanntwerden des Leaks fielen Cybersecurity-Aktien am Freitag deutlich. Der iShares Expanded Tech-Software Sector ETF (IGV) verlor rund drei Prozent. Auch Bitcoin rutschte zurück auf 66.000 US-Dollar. Die Logik der Investoren: Wenn KI-Modelle Schwachstellen schneller finden als Verteidiger sie patchen können, steigt das Risiko für die gesamte digitale Infrastruktur – und das drückt auf die Bewertungen von Unternehmen, die auf genau diese Infrastruktur setzen.

Was das für IT-Dienstleister und Systemhäuser bedeutet

Wenn Anthropic selbst sagt, dass sein neues Modell die Fähigkeiten von Verteidigern übertreffen kann, dann ist das kein Marketing – das ist eine Warnung. Für IT-Dienstleister ergeben sich daraus mehrere konkrete Handlungsfelder:

- Vulnerability-Scanning beschleunigen: Wenn KI-Modelle Schwachstellen in Minuten statt Wochen finden, müssen Patch-Zyklen entsprechend schneller werden. Wöchentliche Scans sind das Minimum, idealerweise automatisiert und kontinuierlich.

- Shadow AI ernst nehmen: Jeder unkontrolliert eingesetzte KI-Agent im Kundennetzwerk ist ein potenzielles Einfallstor. IT-Dienstleister brauchen eine klare Strategie, um Shadow AI bei ihren Kunden zu identifizieren und einzudämmen – bevor Angreifer es tun.

- Red-Teaming als Standard etablieren: KI-gestützte Penetrationstests werden zur Pflicht. Wer heute noch manuell testet, testet zu langsam.

- KI-Governance beim Kunden aufbauen: 63 Prozent der Unternehmen haben keine Governance-Richtlinien für KI. Hier liegt ein konkretes Beratungsfeld, das gleichzeitig Sicherheit und Umsatz bringt.

- Dual Use verstehen und kommunizieren: Dieselben Modelle, die Angreifer nutzen können, helfen auch bei der Verteidigung. IT-Dienstleister, die diese Werkzeuge beherrschen, werden für ihre Kunden unverzichtbar.

"Aus meiner Sicht zeigt dieser Vorfall vor allem eines: Die nächste Generation von KI-Modellen verschiebt die Kräfteverhältnisse in der Cybersecurity grundlegend. Wer als IT-Dienstleister jetzt nicht in KI-gestützte Sicherheit investiert, wird seinen Kunden bald nicht mehr auf Augenhöhe helfen können." – Ingo Lücker, Gründer der KI LEAGUE

Einordnung: Zwischen Warnsignal und Marketingkalkül

Man sollte bei der Bewertung dieses Leaks auch einen kühlen Kopf bewahren. Anthropic hat ein wirtschaftliches Interesse daran, die Fähigkeiten seines neuen Modells als bahnbrechend darzustellen. Die Warnung vor "beispiellosen Cybersecurity-Risiken" positioniert Mythos gleichzeitig als extrem leistungsfähig – was bei Enterprise-Kunden Begehrlichkeiten weckt.

Gleichzeitig ist die Bedrohung real: Bereits dokumentierte Fälle zeigen, dass staatlich gesponserte Hackergruppen Claude-Modelle aktiv für Cyberangriffe missbrauchen. Anthropic selbst hat im November 2025 eine koordinierte Kampagne einer chinesischen Gruppe aufgedeckt, die Claude Code nutzte, um rund 30 Organisationen zu infiltrieren.

Die Wahrheit liegt vermutlich in der Mitte: Die Cyber-Fähigkeiten sind real und ernst zu nehmen, aber der kontrollierte Rollout zeigt auch, dass Anthropic die Risiken managen will. Für IT-Dienstleister zählt am Ende nur eine Frage: Sind meine Kunden vorbereitet?

Einladung zum nächsten KI LEAGUE Live Talk

Der Live Talk richtet sich bewusst an IT-Dienstleister und Systemhäuser, die KI einordnen wollen. Die Teilnahme ist kostenlos – der Austausch ausdrücklich erwünscht.

Einladung zur KI LEAGUE

Die KI LEAGUE ist der Ort für IT-Dienstleister, die KI nicht hypen, sondern verstehen wollen. Als Plattform für Einordnung, Austausch und kritische Diskussion – jenseits von Buzzwords und Produktversprechen.

Jetzt informieren und dabei sein

Quellen

1. Fortune: Exclusive – Anthropic acknowledges testing new AI model

2. Axios: Everyone's worried that AI's newest models are a hacker's dream weapon

3. Euronews: What is Anthropic's Mythos?

4. Dark Reading: 2026 – The Year Agentic AI Becomes the Attack-Surface Poster Child

5. IBM: Cost of a Data Breach Report 2025