Die Frage ist nicht mehr ob, sondern wann

Es kommt nicht mehr darauf an, ob man gehackt wird oder wann, sondern wie oft.

Dieser Satz galt lange für Ransomware. Für 2026 gilt er für etwas Neues: Deepfake-gestützten Betrug. Voice-Clones, synthetische Videocalls, KI-generierte Mails, die sich lesen, als kämen sie aus dem Office nebenan. Die Bedrohungslage hat sich in den letzten zwölf Monaten so grundlegend verschoben, dass die meisten mittelständischen Unternehmen noch gar nicht gemerkt haben, in welcher Welt sie jetzt operieren.

Die Zahlen sind brutal. Deepfake-Betrug hat 2025 allein in US-Unternehmen 1,1 Milliarden Dollar Schaden verursacht – eine Verdreifachung gegenüber den 360 Millionen des Vorjahres. In Deutschland ist die Deepfake-Betrugsrate im ersten Quartal 2025 um 1.100 Prozent gegenüber dem Vorjahr gestiegen. 62 Prozent der Unternehmen weltweit haben laut einer Gartner-Studie vom September 2025 in den vergangenen zwölf Monaten Deepfake-Angriffe erlebt. Und 80 Prozent haben keine etablierten Protokolle, um damit umzugehen.

Das ist keine Zukunftsmusik. Das ist der Arbeitsalltag 2026.

Dieser Artikel ordnet ein, wie sich die Bedrohung konkret verändert hat – und zeigt danach, was IT-Dienstleister jetzt konkret an Schutzmaßnahmen am Kunden umsetzen sollten. Kein Hype, sondern die Dinge, die im Ernstfall den Unterschied machen.

Was sich 2024 bis 2026 wirklich verändert hat

Drei technologische Sprünge haben die Bedrohungslage komplett verschoben – und keiner davon lässt sich mehr zurückdrehen.

Sprung 1: Voice-Cloning in drei Sekunden. Moderne Voice-Cloning-Tools wie ElevenLabs brauchen nicht mehr zehn Minuten Audiomaterial, sondern drei Sekunden. Ein kurzes Video auf LinkedIn, ein Podcast-Ausschnitt, eine Voicemail – das reicht für eine Stimmkopie mit 85 Prozent Übereinstimmung. Voice-Cloning-Betrug ist 2025 um 680 Prozent gegenüber dem Vorjahr gestiegen. Das Rohmaterial liefern die Angegriffenen kostenlos: Jede Konferenz-Aufzeichnung, jedes Webinar, jeder Podcast-Auftritt des CEO ist Trainingsdaten für den nächsten Angriff.

Sprung 2: Live-Deepfakes in Videocalls. Bis 2023 waren Deepfakes vorproduzierte Videos. 2026 sind sie interaktiv. Angreifer sitzen live in Videokonferenzen, reagieren auf Fragen, stellen Gegenfragen, übertragen Mimik und Gestik in Echtzeit. Der bekannteste Fall: Das britische Ingenieurbüro Arup verlor 25,6 Millionen Dollar, weil ein Finanzangestellter in Hongkong an einem Videocall teilnahm, in dem der CFO und mehrere Kollegen zu sehen waren. Jeder einzelne Teilnehmer war eine Deepfake-Simulation. Der Mitarbeiter führte 15 Überweisungen an einem Tag aus.

Sprung 3: KI-generierte Mails ohne Rechtschreibfehler. Die klassischen Warnsignale sind weg. Früher verrieten sich Phishing-Mails durch schlechtes Deutsch, komische Formulierungen, offensichtliche Stilbrüche. Heute generieren Angreifer perfekte Geschäftskommunikation – inklusive des spezifischen Jargons der jeweiligen Branche und des Schreibstils einzelner Führungskräfte. Laut dem Sagiss Managed Security Report vom April 2026 sagen 72 Prozent der befragten Büromitarbeiter, dass sie KI-generierte Phishing-Mails kaum noch erkennen können. 82 Prozent aller Angriffs-Mails kommen mittlerweile von Maschinen. Das Volumen hat sich in zwei Jahren mehr als verdoppelt – 2025 wurde alle 19 Sekunden eine Phishing-Mail abgefangen.

Diese drei Sprünge zusammen ergeben eine neue Angriffslogik, die man verstehen muss: Mehrkanalige, koordinierte Attacken. Die Mail bereitet vor, der Telefonanruf mit geklonter Stimme bestätigt, der Videocall besiegelt. Drei Kanäle, die sich gegenseitig authentifizieren – jeder für sich wirkt plausibel, die Kombination erzeugt scheinbare Gewissheit. Genau so funktionierte der Arup-Angriff. Und genau so funktionieren die Angriffe, die 2026 täglich auf deutsche Mittelständler rollen.

Warum gerade der Mittelstand das Lieblingsziel ist

Wer jetzt denkt, „das betrifft nur Großkonzerne wie Arup“ – der liegt falsch. Deutsche Mittelständler sind aus drei Gründen besonders verwundbar:

Flache Hierarchien. In vielen mittelständischen Unternehmen hat der CFO direkten Zugang zu Überweisungssystemen. Es gibt kein striktes Vier-Augen-Prinzip für Transaktionen unter 100.000 Euro. Ein einziger getäuschter Finanzverantwortlicher kann in Minuten sechsstellige Beträge überweisen – ohne dass ein zweiter Mensch zustimmt.

Eine Kultur des kurzen Dienstwegs. Anweisungen vom Chef werden selten hinterfragt. „Der Chef hat gesagt, das muss heute noch raus“ ist in vielen Firmen ein Satz, der Prozesse aushebelt. Genau darauf zielen Deepfake-Angriffe: Sie simulieren Autorität und Dringlichkeit gleichzeitig.

Öffentliches Rohmaterial. Mittelständische Geschäftsführer geben Interviews, treten auf Kongressen auf, machen LinkedIn-Videos, moderieren Webinare. Jede dieser Aktivitäten ist Trainingsmaterial. Security-Experten schätzen, dass 60 bis 80 Prozent der Führungskräfte in Fortune-500-Unternehmen genügend öffentliches Videomaterial für hochwertige Deepfakes liefern. In deutschen Mittelstandsunternehmen liegt die Quote kaum niedriger – viele Geschäftsführer sind heute aktive Personal Brands.

Die Rechnung ist einfach: Großkonzerne haben Security-Teams, Verifizierungsprotokolle, Incident-Response-Pläne. Mittelständler haben einen IT-Leiter, der nebenbei noch die Telefonanlage betreut. Für Angreifer ist die Erfolgswahrscheinlichkeit im Mittelstand deutlich höher – bei vergleichbaren Beträgen. Weshalb der Mittelstand für KI-gestützte Angreifer das ökonomisch attraktivere Ziel ist.

Auf der technischen Seite verschärft sich das Bild durch Parallelentwicklungen wie kompromittierte KI-Modelle und leckende Entwicklerumgebungen – wie wir am Beispiel des Claude-Code-Leaks bereits gezeigt haben, sind heute auch die Angriffswerkzeuge selbst frei zugänglich.

Der Denkfehler, den fast alle machen: „Wir setzen auf Erkennung“

Wenn man mit IT-Verantwortlichen über Deepfake-Schutz spricht, kommt fast immer dieselbe Frage: „Gibt es ein Tool, das Deepfakes erkennt?“

Ja, die gibt es. Pindrop, Sensity AI, Resemble Detect, Intel FakeCatcher, Reality Defender. Die Erkennungsraten liegen bei 85 bis 95 Prozent – je nach Qualität der Fälschung. Klingt gut. Ist aber die falsche Strategie.

Warum? Deepfake-Erkennung ist ein Katz-und-Maus-Spiel, bei dem die Maus strukturell schneller ist als die Katze. Jedes Mal, wenn eine Erkennungstechnologie einen neuen Typus von Artefakten identifiziert, produziert die nächste Generation der Generatoren Fälschungen ohne dieses Artefakt. Die Erkennungslage hat sich 2024 bis 2026 fundamental verschlechtert, nicht verbessert. Technische Detection kann unterstützen – sie kann niemals die Hauptverteidigungslinie sein.

Die Konsequenz ist unbequem, aber eindeutig: Prozesse sind wichtiger als Technik. Wer heute Zahlungsfreigaben, Zugriffe oder vertrauliche Informationen auf Basis einer einzelnen Video- oder Audio-Verifikation vergibt, öffnet Deepfakes Tür und Tor – egal wie gut die Detection-Software ist, die im Hintergrund mitläuft.

Das ist genau der Punkt, an dem IT-Dienstleister beim Kunden den Unterschied machen. Nicht durch den Verkauf einer weiteren Software-Lizenz, sondern durch das Aufsetzen der Prozesse, die den Schaden im Ernstfall verhindern.

Was IT-Dienstleister jetzt beim Kunden aufsetzen müssen

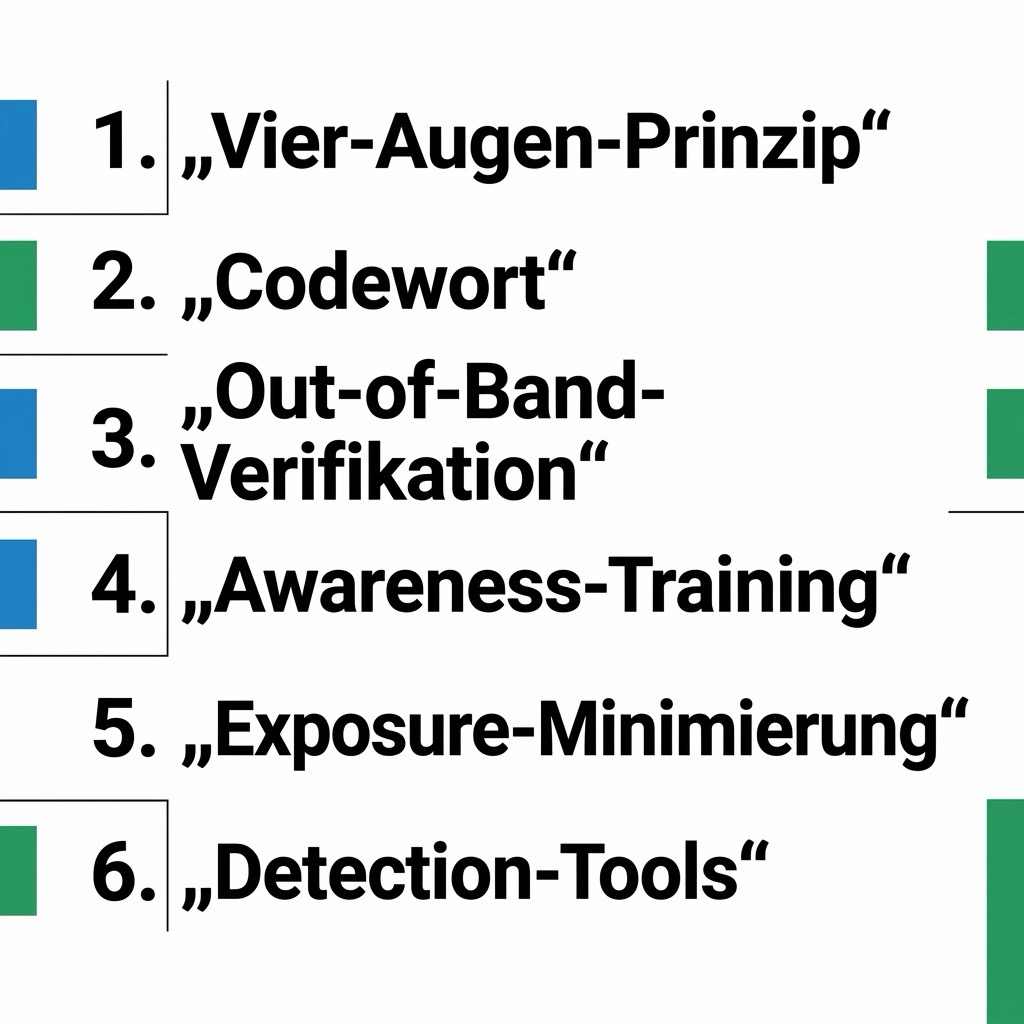

Sechs Maßnahmen, die sich in der Praxis als wirksam erwiesen haben – und die jeder IT-Dienstleister seinen Kunden jetzt anbieten sollte. Die Reihenfolge ist nicht zufällig: Die Maßnahmen oben sind die mit dem größten Wirkungs-zu-Aufwand-Verhältnis.

1. Striktes Vier-Augen-Prinzip für Finanztransaktionen. Keine Überweisung über einer definierten Schwelle (empfohlen: 5.000 Euro) ohne zweite Freigabe. Jede neue Empfängerbank, jede IBAN-Änderung, jede ungewöhnliche Transaktion braucht eine Zweitverifikation über einen unabhängigen Kanal. Das ist die wichtigste einzelne Maßnahme. Sie hätte den Arup-Schaden verhindert.

2. Codewort-Protokoll für dringende Anfragen. Jeder Mitarbeiter mit Zahlungsbefugnis vereinbart mit der Geschäftsführung ein Codewort. Kommt eine Anfrage über Video, Audio oder Mail, die Zeitdruck suggeriert, wird das Codewort abgefragt. Kein Codewort – keine Ausführung. Das klingt altmodisch, ist aber derzeit die wirksamste einfache Gegenmaßnahme. Die Deutsche Polizei empfiehlt das Verfahren explizit.

3. Out-of-Band-Verifikation als Pflichtprozess. Bei jeder verdächtigen Anfrage wird auf einer hinterlegten Festnetznummer zurückgerufen – nie auf der Nummer, die in der Mail oder im Call genannt wurde. Diese Regel muss in der Unternehmensrichtlinie stehen, nicht nur im Kopf des IT-Leiters. Und sie muss so formuliert sein, dass Mitarbeiter sie auch unter Druck anwenden.

4. Awareness-Training mit echten Deepfake-Demos. Klassische Phishing-Schulungen sind 2026 nicht mehr ausreichend. Mitarbeiter müssen einmal live erleben, wie gut ein Voice-Clone der eigenen Führungskraft klingt – damit sie verstehen, dass die Abwehr nicht beim Zuhören beginnt, sondern beim Prozess. Realistische Simulationen (Audio und Video) gehören in jedes Awareness-Programm. Phishing-Mail-Tests reichen nicht mehr.

5. Exposure-Minimierung für exponierte Personen. Nicht jedes interne Meeting muss aufgezeichnet werden. Nicht jede Keynote muss ungeschützt auf YouTube landen. Nicht jeder Podcast-Auftritt ist eine gute Idee. Eine Deepfake-Risikoanalyse sollte pro Führungskraft prüfen: Wie viel öffentliches Audio- und Videomaterial existiert? Welche Transaktionsprozesse sind mit dieser Person verknüpft? Daraus folgt eine bewusste Kommunikationsstrategie – keine Paranoia, aber kein naives „Je mehr, desto besser“.

6. Technische Detection als vierte Verteidigungslinie. Erst jetzt kommt die Technik ins Spiel – als Ergänzung, nicht als Ersatz. KI-gestützte E-Mail-Security (Abnormal Security, Proofpoint VAP), phishing-resistente MFA (FIDO2/Passkeys statt SMS-TANs) und bei Bedarf spezialisierte Deepfake-Detection-Tools für besonders exponierte Bereiche. Wichtig: Diese Tools arbeiten immer hinter den Prozessen, nicht statt ihnen.

Die Reihenfolge ist entscheidend. Wer bei Punkt 6 anfängt und die Punkte 1 bis 5 ausklammert, hat viel Geld ausgegeben und wenig Schutz dazugewonnen. Wer bei Punkt 1 anfängt und sauber bis Punkt 5 durcharbeitet, hat 90 Prozent der realistischen Angriffsszenarien abgedeckt – ohne einen einzigen Euro für Spezialsoftware ausgegeben zu haben.

Der blinde Fleck: NIS2, Haftung und die neue Board-Verantwortung

Ein Punkt, den viele übersehen: Deepfake-Schutz ist 2026 keine optionale Security-Übung mehr. Er ist eine persönliche Haftungsfrage für die Geschäftsführung.

Mit der NIS2-Umsetzung liegt die persönliche Haftung der Geschäftsleitung für Cybersicherheitsmaßnahmen deutlich klarer auf dem Tisch als früher. Wenn nachweislich keine angemessenen Schutzmaßnahmen gegen eine bekannte Bedrohung getroffen wurden, kann das im Schadensfall als grobe Fahrlässigkeit gewertet werden. Deepfake-Betrug ist 2026 eine bekannte Bedrohung. Das bedeutet: Wer jetzt nichts tut, baut sich ein Haftungsrisiko auf, das im Ernstfall nicht mehr auf das Unternehmen begrenzt ist, sondern die Geschäftsleitung persönlich trifft.

Für IT-Dienstleister ist das ein starkes Argument im Kundengespräch. Nicht als Drohung, sondern als Klärung: Der Geschäftsführer, der jetzt in Deepfake-Schutz investiert, schützt nicht nur sein Unternehmen – er schützt auch sich selbst. Und der IT-Dienstleister, der diese Gespräche führt, wird nicht als Verkäufer wahrgenommen, sondern als Berater, der das große Bild versteht.

Parallel dazu greift ab dem 2. August 2026 die Kennzeichnungspflicht für Deepfakes aus Artikel 50 des EU AI Act. Die bringt allerdings nur begrenzten Nutzen gegen kriminelle Akteure – wer Menschen um Geld betrügen will, hält sich ohnehin nicht an EU-Verordnungen. Die Kennzeichnungspflicht betrifft legitime Anwender. Die Bedrohung durch kriminelle Deepfakes wird der Gesetzgeber nicht lösen. Wie der gesamte Stichtag und seine Konsequenzen für Unternehmen aussehen, haben wir im Artikel EU AI Act: Was ab dem 2. August 2026 wirklich gilt ausführlich eingeordnet.

Die unterschätzte Pflicht: KI-Kompetenz als wirksamste Verteidigung

Hier wird es strategisch interessant. Der EU AI Act verlangt seit dem 2. Februar 2025 nach Artikel 4, dass jedes Unternehmen, das KI einsetzt, die KI-Kompetenz seiner Mitarbeitenden sicherstellen muss. Das ist längst geltendes Recht – und fällt direkt mit der Deepfake-Bedrohungslage zusammen.

Denn die „menschliche Firewall“ ist bei KI-gestütztem Betrug die wichtigste Verteidigungslinie. Kein Tool, keine Detection-Software, kein Firewall-Setup fängt einen Voice-Clone ab, der einen Mitarbeiter um eine dringende Überweisung bittet. Nur ein Mitarbeiter, der weiß, wie Deepfakes funktionieren, welche Angriffsmuster existieren und welchen Prozessen er im Zweifel folgt, kann den Angriff abwehren.

Genau dafür haben wir den KI-Kompetenznachweis der KI LEAGUE entwickelt: einen modularen Schulungskurs nach EU-Standard, der die Anforderungen aus Artikel 4 strukturiert abdeckt – inklusive Modulen zu Deepfake-Erkennung, Social Engineering und sicheren Prozessen im Umgang mit KI-generierten Inhalten. Mit begleitenden Assessments und einem dokumentierten Abschlussnachweis pro Mitarbeitendem. Halbjährliche Update-Module halten den Nachweis auch bei neuen Bedrohungen aktuell. Der Kurs funktioniert sowohl für das eigene Systemhaus als auch als Leistung, die IT-Dienstleister ihren Kunden anbieten können – als Compliance-Produkt, das gleichzeitig eine der wirksamsten Deepfake-Abwehrmaßnahmen ist, die ein Unternehmen überhaupt umsetzen kann.

Wer den KI-Kompetenznachweis für das eigene Unternehmen oder für Kunden einsetzen möchte, schreibt einfach eine kurze Mail an ingo.luecker@kileague.de – dann klären wir im direkten Gespräch, wie die Umsetzung konkret aussehen kann.

Warum die Kompetenzfrage auch jenseits der reinen Abwehr zur strategischen Basiskompetenz für IT-Dienstleister wird, haben wir im Artikel KI wird Basiskompetenz ausgeführt.

Einordnung: Eine neue Security-Grundannahme

Der wichtigste Satz dieses Artikels ist nicht der mit den 1,1 Milliarden Dollar Schaden. Es ist der, der daraus folgt: Sehen und Hören sind keine Identitätsbeweise mehr.

Zwanzig Jahre lang war die Grundannahme der Unternehmenssicherheit: Wenn ich die Person am Telefon höre oder im Videocall sehe, weiß ich, mit wem ich spreche. Diese Annahme ist 2026 nicht mehr tragbar. Sie muss aktiv aus den Köpfen der Mitarbeiter entfernt und durch eine neue ersetzt werden: Identität ist Prozess, nicht Wahrnehmung.

Für IT-Dienstleister bedeutet das: Deepfake-Schutz ist kein Einzelprodukt, sondern ein Paradigmenwechsel, den man mit dem Kunden gemeinsam vollzieht. Wer diesen Wechsel vermitteln und operationalisieren kann, hat eines der stärksten Beratungsargumente der kommenden Jahre – weil jeder Geschäftsführer, dem der Arup-Fall einmal sauber erklärt wurde, sofort versteht, worum es geht.

Und er ist das stärkste Beispiel dafür, warum der alte Satz aus der Cybersecurity heute wahrer ist als je zuvor: Es kommt nicht mehr darauf an, ob man gehackt wird oder wann, sondern wie oft. Die Angreifer arbeiten mit Werkzeugen, die noch vor drei Jahren Hollywood-Filmstudios gehörten. Die Abwehr muss auf derselben Höhe operieren – mit Prozessen, die nicht auf menschliche Wahrnehmung vertrauen, sondern auf strukturierte Verifikation.

Einladung zum nächsten KI LEAGUE Live Talk

Wenn dich die Frage beschäftigt, wie du Deepfake-Schutz konkret beim Kunden aufbaust – und wie du daraus ein belastbares Beratungsangebot machst – dann ist der nächste KI LEAGUE Live Talk genau dafür gedacht.

Einmal im Monat ordnen wir aktuelle KI-Entwicklungen ein, teilen validierte Erkenntnisse und diskutieren, was das konkret für IT-Dienstleister und Systemhäuser bedeutet. Kein Hype, kein Buzzword-Bingo – sondern Substanz.

Jetzt beim nächsten Live Talk dabei sein

Einladung zur KI LEAGUE

Die KI LEAGUE ist der Ort für IT-Dienstleister, die KI nicht hypen, sondern verstehen wollen. Werde Teil der Community und profitiere von monatlichen Live Talks, Deep Dives und dem Austausch mit Gleichgesinnten.

Mehr über die KI LEAGUE erfahren

Quellen

- Digital Chiefs: Deepfake-Schutz für C-Level – Der CEO ist nicht echt (09.02.2026) – digital-chiefs.de

- Fortune: Boards aren't ready for the AI age – What happens when your CEO gets deepfaked (03.03.2026) – fortune.com

- Security-Insider: KI-Betrug – Deepfakes, Wissenschaft und Industrie reagieren (21.01.2026) – security-insider.de

- Digital Magazin: Deepfake-Betrug 2026 – 7 Warnsignale (23.02.2026) – digital-magazin.de

- ad-hoc-news: KI-Phishing – Neue Betrugswelle trifft deutsche Büros (April 2026) – ad-hoc-news.de

- a7 / Jan Hörnemann: KI-Cyberangriffe – Deepfakes, AI-Phishing & Exploits (04.03.2026) – a7.de

- Polizei Dein Partner: Video-Deepfakes & Vishing – Präventionstipps (o.D.) – polizei-dein-partner.de

- Unternehmen Cybersicherheit / VSMA: Deepfake-Angriffe nehmen massiv zu – Zahlen, Fakten, Fallbeispiele (2026) – unternehmen-cybersicherheit.de